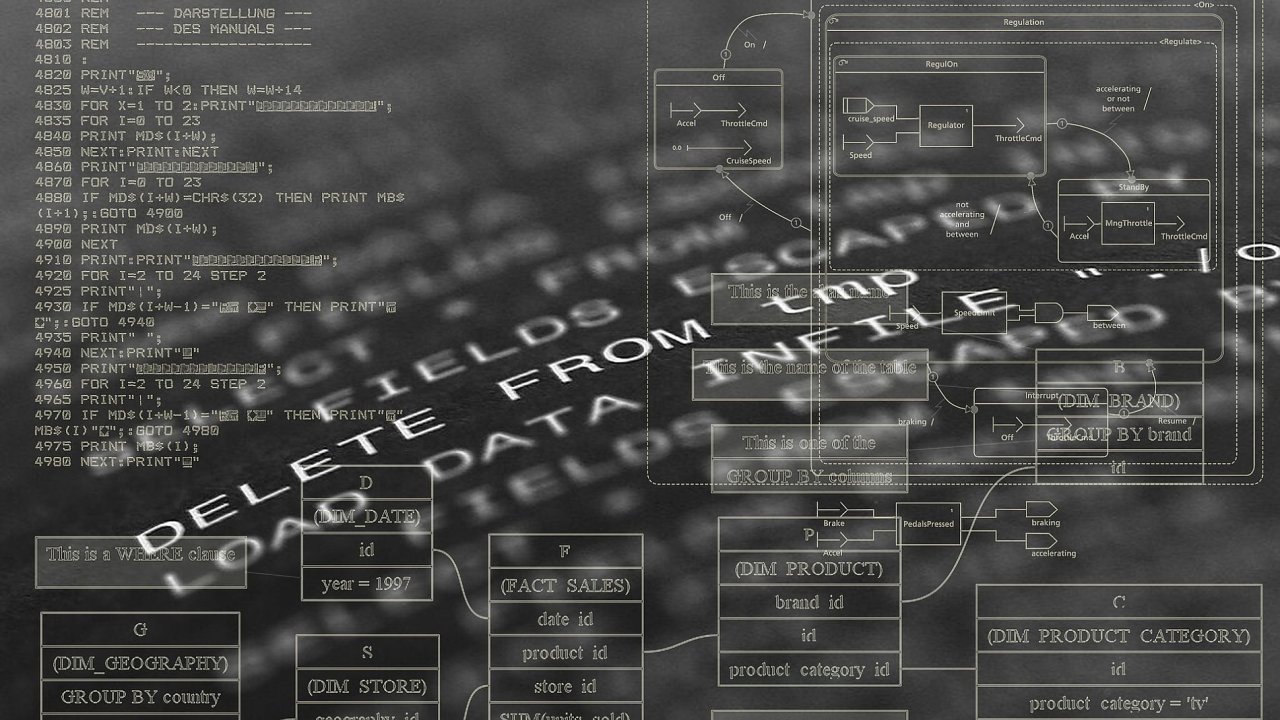

Měla to být velká pomoc programátorům. Umělá inteligence GitHub Copilot umí programátorům navrhnout kód, který nejspíš chtějí napsat. Řídí se přitom analýzou kódu mnoha open source projektů. Aktuální studie však ukázala, že 40 procent návrhů vytvořených na základě strojového učení obsahuje bezpečnostní chyby. To je samozřejmě bezprostřední problém, ale ukazuje to i na obecné limity toho, čemu rádi říkáme umělá inteligence.

Programátoři jsou při psaní kódu v moderních editorech zvyklí na to, že jim počítač pomáhá. Doplňuje například názvy proměnných, metod a funkcí a kontroluje syntaktickou správnost kódu (jestli někde nechybí uzavřená závorka a podobně). To lze přirovnat ke kontrole překlepů v běžném textovém editoru. Ta sice nezajistí, že napsaný text bude správně (po obsahové ani pravopisné stránce), ale odhalí běžné chyby jazykového charakteru (třeba když napíšete „ajko“ místo „jako“).

Článek již není odemčený!

Váš známý vám umožnil přečíst si článek zdarma, ale uplynula doba, po kterou je článek odemčený.

Pro neomezený přístup ke všem článkům na našem webu si můžete zakoupit předplatné za 40 Kč.

- První 2 měsíce za 40 Kč/měsíc, poté za 199 Kč měsíčně

- Možnost kdykoliv zrušit

- Odemykejte obsah pro přátele

- Všechny články v audioverzi + playlist

Přidejte si Hospodářské noviny

mezi své oblíbené tituly

na Google zprávách.

Přidejte si Hospodářské noviny

mezi své oblíbené tituly

na Google zprávách.